WHO a publié de nouvelles orientations sur l'éthique et la gouvernance des grands modèles multimodaux (LMM) pour leur utilisation appropriée pour promouvoir et protéger la santé des populations. Les LMM sont un type d'outil génératif à croissance rapide intelligence artificielle (IA) qui a cinq grandes applications pour la santé in

1. Diagnostic et soins cliniques, comme répondre aux questions écrites des patients ;

2. Utilisation guidée par le patient, par exemple pour étudier les symptômes et le traitement ;

3. Tâches de bureau et administratives, telles que documenter et résumer les visites des patients dans les dossiers de santé électroniques ;

4. Formation médicale et infirmière, notamment en offrant aux stagiaires des rencontres simulées avec des patients, et ;

5. Recherche scientifique et développement de médicaments, notamment pour identifier de nouveaux composés.

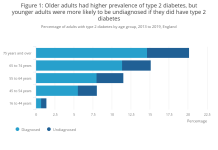

Cependant, ces applications dans le domaine des soins de santé risquent de produire des déclarations fausses, inexactes, biaisées ou incomplètes, ce qui pourrait nuire aux personnes utilisant ces informations pour prendre des décisions en matière de santé. De plus, les LMM peuvent être formés sur des données de mauvaise qualité ou biaisées, que ce soit par race, origine ethnique, ascendance, sexe, identité de genre ou âge. Il existe également des risques plus larges pour les systèmes de santé, tels que l’accessibilité et le caractère abordable des LMM les plus performants. Les LMM peuvent également encourager un « biais d'automatisation » de la part des professionnels de la santé et des patients, par lequel des erreurs qui auraient autrement été identifiées sont négligées ou des choix difficiles sont délégués de manière inappropriée à un LMM. Les LMM, comme d'autres formes de AI, sont également vulnérables aux risques de cybersécurité qui pourraient mettre en danger les informations sur les patients ou la fiabilité de ces algorithmes et la fourniture de soins de santé en général.

Par conséquent, pour créer des LMM sûrs et efficaces, l’OMS a formulé des recommandations à l’intention des gouvernements et des développeurs de LMM.

Les gouvernements ont la responsabilité principale d’établir des normes pour le développement et le déploiement des LMM, ainsi que pour leur intégration et leur utilisation à des fins de santé publique et médicales. Les gouvernements devraient investir ou fournir des infrastructures publiques ou à but non lucratif, y compris une puissance de calcul et des ensembles de données publiques, accessibles aux développeurs des secteurs public, privé et à but non lucratif, qui exigent que les utilisateurs adhèrent à des principes et valeurs éthiques dans échange contre accès.

· Utiliser les lois, politiques et réglementations pour garantir que les LMM et les applications utilisées dans les soins de santé et la médecine, quel que soit le risque ou le bénéfice associé au AI technologie, répondre aux obligations éthiques et aux normes des droits de l’homme qui affectent, par exemple, la dignité, l’autonomie ou la vie privée d’une personne.

· Désigner une agence de réglementation existante ou nouvelle pour évaluer et approuver les LMM et les applications destinés à être utilisés dans les soins de santé ou la médecine – dans la mesure où les ressources le permettent.

· Introduire des audits post-publication et des évaluations d'impact obligatoires, y compris pour la protection des données et les droits de l'homme, par des tiers indépendants lorsqu'un LMM est déployé à grande échelle. L'audit et les analyses d'impact devraient être publiés

et devrait inclure les résultats et les impacts ventilés par type d'utilisateur, y compris par exemple par âge, race ou handicap.

· Les LMM ne sont pas conçus uniquement par des scientifiques et des ingénieurs. Les utilisateurs potentiels et toutes les parties prenantes directes et indirectes, y compris les prestataires médicaux, les chercheurs scientifiques, les professionnels de santé et les patients, devraient être impliqués dès les premières étapes du processus. AI développement dans une conception structurée, inclusive et transparente et des opportunités données pour soulever des questions éthiques, exprimer des préoccupations et apporter leur contribution au AI candidature à l’étude.

Les LMM sont conçus pour effectuer des tâches bien définies avec la précision et la fiabilité nécessaires pour améliorer la capacité des systèmes de santé et faire progresser les intérêts des patients. Les développeurs doivent également être capables de prédire et de comprendre les résultats secondaires potentiels.

***

La source:

OMS 2024. Éthique et gouvernance de l'intelligence artificielle pour la santé : orientations sur les grands modèles multimodaux. Disponible à https://iris.who.int/bitstream/handle/10665/375579/9789240084759-eng.pdf?sequence=1&isAllowed=y

***